IA: quem diria, sua namorada virtual só quer seus dados

90% dos chatbots de IA que se apresentam como "namoradas virtuais" vendem dados de usuários a terceiros, revela pesquisa da Mozilla

Ronaldo Gogoni 2 anos atrás

A Inteligência Artificial (IA) é a febre do momento, mas ela pegou anos atrás com os chatbots generativos, hoje representados por produtos de ponta como o GPT-4, o Microsoft Copilot, o Google Bard Gemini, e outros.

- A japinha assistente virtual holográfica está sendo "americanizada"

- Japas Tarados a um passo da namorada virtual ideal

LLMs (grandes modelos de linguagem) viabilizam todo tipo de chatbot, no que um dos formatos mais populares, e lucrativos, é o das namoradas virtuais, mirando em gente solitária como o Joaquin Phoenix, boa parte deles de acesso gratuito. Claro que sempre há um preço a pagar, neste caso, sua cara-metade digital revende todos os dados sensíveis que consegue coletar.

Ela não existe, mas vai coletar todos os seus dados, até os mais sensíveis, mesmo assim (Crédito: Stable Diffusion)

Para muita gente, o ato de conversar com um bot não é nada de mais, a maioria das pessoas sabe que está dialogando com um algoritmo, desprovido de inteligência real e consciência, mas outros, por um motivo ou outro, mantêm relacionamentos mais profundos com avatares, e isso nem é algo exclusivo de chatbots.

Quando os LLMs se tornaram mais acessíveis, começaram a surgir sites, apps e serviços diversos de companhias digitais, quer oferecem modelos prontos de namorados e namoradas virtuais para os usuários, com direito a voz digitalizada e aparência gerada em modelos como Stable Diffusion. Claro, é possível também criar seu próprio crush digital, definindo aparência, idade, etnia, personalidade, ocupação, tom de voz, etc. e tal.

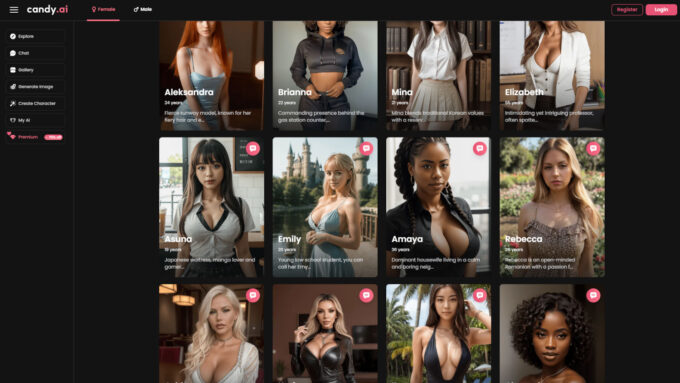

Sites como Candy.ai, Chai e Anima, entre outros, estão entre os mais populares e com maior visitação de usuários, mas a onda também atraiu influenciadores digitais, que correram para desenvolver e disponibilizar versões virtuais deles próprios (mulheres em sua maioria), e como previsto, estão lucrando muito.

Excluindo experiências premium fechadas, a maioria dos sites e apps que oferecem experiências com chatbots movidos por IA são gratuitos, exigindo apenas que o usuário crie um perfil. A pesquisa realizada pela Mozilla Foundation, no entanto, confirma a máxima "se é gratuito, você é o produto".

A fundação analisou 11 plataformas e chats, entre eles o Chai, que já se envolveu em polêmicas no passado: em dezembro de 2021, uma fembot do site teria estimulado um homem a invadir o castelo de Windsor, no Reino Unido, para matar a rainha Elizabeth II; em março de 2023, um homem cometeu suicídio na Bélgica, no que ele teria sido incentivado por outra namoradinha virtual do serviço, que supostamente encorajou seus pensamentos autodestrutivos.

Claro que uma conversa com um bot é um tanto unilateral, o algoritmo tende a reforçar impressões da pessoa que está interagindo com ele, mas as empresas responsáveis por tais experiências deveriam colocar medidas de segurança em suas ferramentas online; de qualquer forma, não é nesse ponto em que a Mozilla se concentrou.

Sites como Candy.ai oferecem diversas opções de chatbots gerados por IA (Crédito: Reprodução/Candy.ai)

Nesse ponto, os serviços especificam, em seus Termos de Uso, não serem responsáveis por nada que os chatbots disserem, incentivarem os usuários a fazerem, ou por quaisquer consequências das conversas entre o humano e sua namorada digital. Não há nenhuma informação legal sobre como esses algoritmos funcionam, e eles coletam todo o tipo de informação compartilhada, de diversas formas, e sim, todos usam trackers, que vasculham seus dispositivos.

Sobre questões clássicas de segurança, e os resultados também não foram bons. Dos 11 analisados, apenas o Genesia - AI Friend & Partner, disponível como um app móvel, atende as exigências mínimas de segurança de dados e privacidade, e sobre o destino dos dados, só o EVA AI Chat Bot & Soulmate, outro app móvel, não revende as informações que garimpa a terceiros.

A Mozilla concluiu que tais bots são desenvolvidos por padrão a coletar o máximo de dados possível, o que inclui os mais sensíveis possíveis. É fácil de entender, nós costumamos nos abrir com aqueles em quem mais confiamos, e uma waifu toda meiga, agindo como a namoradinha perfeita, mesmo que seja movida por algoritmos, é algo que muitos não conseguem resistir.

AA pesquisa também revelou que 73% dos serviços não dão nenhuma satisfação quanto à segurança dos dados, 64% não mencionam criptografia, e 45% permitem senhas fracas, inclusive compostas por apenas um caractere. Algumas dessas decisões violam leis como a GDPR da União Europeia, e a LGPD do Brasil.

A Mozilla recomenda aos usuários que não conseguem evitar interagir com chatbots de IA, a usar senhas fortes, limpar periodicamente seus dados (e exigir que as companhias façam o mesmo, quando optarem por encerrar seus perfis), não permitir que seus dados e conversas sejam usados para treinar algoritmos (opt-out), e limitar ou impedir o acesso a recursos que não sejam necessários ao uso dos apps e sites, principalmente em dispositivos móveis, como galeria de imagens, câmera, microfone, geolocalização, etc.

Claro, o ideal continua sendo não conversar com namoradinhas de IA online, se você não puder criar sua própria localmente, mas se não houver como evitar, a regra de ouro permanece inalterada: não dê mole.

Fonte: Mozilla Foundation