Por que carros autônomos precisam ser programados pra matar?

Carros autônomos precisam ser programados para salvar vidas, mas a indústria robótica terá que programar os automóveis do futuro para matar pessoas. Leia o motivo.

Matheus Gonçalves 8 anos e meio atrás

Eu sei que o título parece pesado. Muitos podem argumentar que deveria ser algo mais voltado para “carros precisam ser programados para salvar vidas” e eu concordo em parte.

Mas continue lendo para entender melhor a diferença crucial aqui.

Há um tempo considerável já estamos ouvindo falar de carros autônomos, aqueles veículos que não precisam de motorista e que se guiam sozinhos.

Pouca gente sabe, mas no Brasil tem bastante gente trabalhando nisso. Me lembro em 2008, quando eu ainda estudava e trabalhava na FEI de São Bernardo do Campo e fui convidado para avaliar um projeto de detecção de limites de pista para veículos autônomos inteligentes, que usava visão computacional. Era bem legal, com projeções 3D da pista em tempo real. Alguma montadora do ABC deve ter visto isso, mas não sei dizer se o estudo virou um projeto comercial, mas outros engenheiros no mundo todo estão disputando esta nova corrida tecnológica.

Como podemos ver neste post do Cardoso de maio de 2014, empresas como Google, BMW, Audi e, mais recentemente, Tesla, trabalham ávidamente para dar este tipo de inteligência aos seus carros.

Muita coisa evoluiu desde os primeiros projetos e hoje podemos dizer que os conceitos básicos de pilotagem estão relativamente calibrados. Ou quase. Ainda é necessário configurar os limites para todas as vias, evitando que o motorista seja parado pela polícia e tome multas por excesso de velocidade:

Tesla Model S version 7 Autopilot Speeding Ticket Auto Steering Demo on Streets, Highway, Traffic

E também ler os logs do debug pra entender porque é que o volante vira para o lado errado só para assustar o piloto:

2015-10-15 With 'Seany-cab' ©®TM LLC The future has arrived...well, almost.

Falando sério agora, estes sistemas estão cada vez mais estáveis. Tarefas que antes eram absurdamente complexas, como acelerar, frear, trocar de faixa e identificar obstáculos, hoje se tornaram simples. Virou framework. O que abre espaço para melhorias bem mais complicadas.

O MIT divulgou esta semana um estudo muito interessante, que vem sendo feito desde julho deste ano, sobre decisões éticas que devem ser tomadas por carros autônomos.

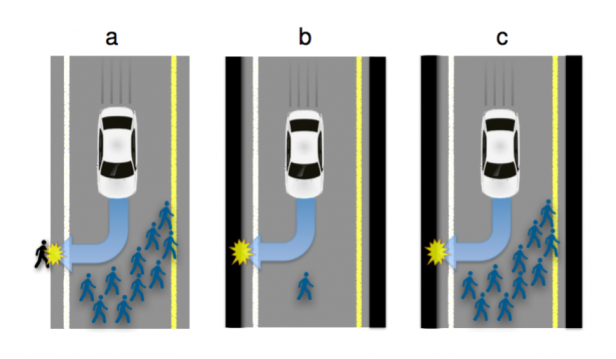

E isso levanta questões bem difíceis de serem respondidas. Por exemplo, como o carro deve ser programado pra agir em caso de estar diante de um acidente inevitável. Ele deve minimizar o número de vítimas fatais, mesmo que isso signifique sacrificar os ocupantes do carro? Ou deve proteger motorista e passageiros a todo custo? Talvez escolher aleatoriamente entre estes casos?

A resposta para estas perguntas pode impactar diretamente na maneira como carros autônomos serão aceitos em nossa sociedade. Afinal, quem iria comprar um carro programado para sacrificar o próprio dono? Well…

O trabalho de Jean-Francois Bonnefon e outros cientistas da Escola de Economia de Toulouse, na França, foi feito justamente para tentar achar as melhores respostas para estes problemas, usando pesquisas com opinião pública e metodologias que envolviam apresentar diferentes cenários e possíveis consequências para cada um dos acidentes.

E com dilemas da seguinte natureza:

“Imagine que em um futuro não muito distante, você possua um carro autônomo. Um certo dia, você está dirigindo tranquilamente quando um conjunto infeliz de eventos faz com que seu carro vá em direção a um grupo de 10 pessoas que estão tentando atravessar a estrada.

É impossível frear completamente, dada a distância, mas o carro pode evitar a morte de 10 pessoas, se o carro for direciodo a uma parede. Essa colisão, no entanto, pode matar o motorista e um outro ocupante. O que o carro deve fazer?”

Claro que o principal objetivo aqui é diminuir o número de vítimas fatais, mas o software precisa decidir quem ele vai, eventualmente, matar. Tirar a vida de duas pessoas é melhor que tirar a vida de dez. Certo? Então…

E se no carro estiver um bebê? Isso muda os parâmetros? E se ao lado do carro estiver um motociclista? (se neste momento você pensou “dane-se o motoboy”, deu ruim. Volte duas casas.)

Um ponto importante a se pensar é o seguinte: se a gente tiver carros que colocam o motorista em risco, poucas pessoas vão comprá-lo. Se poucas pessoas comprá-los, estatísticamente, menos vidas serão poupadas, o que leva a um número maior de mortos de qualquer forma.

O resultado da pesquisa foi muito interessante, mas não conclusivo. Na maioria dos casos, as pessoas preferiam que o carro fosse programado para evitar o maior número de mortes mesmo que isso pudesse tirar a vida do motorista. Desde que, neste caso, o motorista não seja a própria pessoa:

E é aí que reside o paradoxo. As pessoas são a favor de carros que sacrificam o ocupante para salvar outras vidas, contanto que eles não tenham que conduzir um carro assim.

Em outras palavras, “eu quero mais que o motorista desvie de mim, ele que se exploda!"”… Humanos…

Como quase tudo na ciência, novas respostas geram novas perguntas e agora os pesquisadores também estão trabalhando com outros modelos hipotéticos, como por exemplo: se um fabricante oferecer diferentes versões de seu algorítimo de tomada de decisões morais, e um comprador escolher conscientemente um deles, seria este comprador o responsável por eventuais acidentes e suas consequências?

São questões que não podem ser ignoradas, afinal estamos prestes a colocar milhões de carros autônomos nas ruas, portanto a questão moral destes algorítimos nunca foi tão urgente.

E você, na situação apresentada acima, qual seria sua resposta? Deixe sua opinião aqui na área de comentários.